Wie Anomaly Detection die Alarmqualität verbessern kann

Alarme und Monitoring gehören einfach zusammen. Immer wenn ein Algorithmus oder Grenzwert verwendet wird, um zu kontrollieren ob der derzeitige Wert eines aufgezeichneten KPIs einen Alarm generieren sollte oder nicht, gibt es vier verschiedene Ergebnisse: Treffer, Verpasser, falscher Alarm und korrekte Ablehnung.

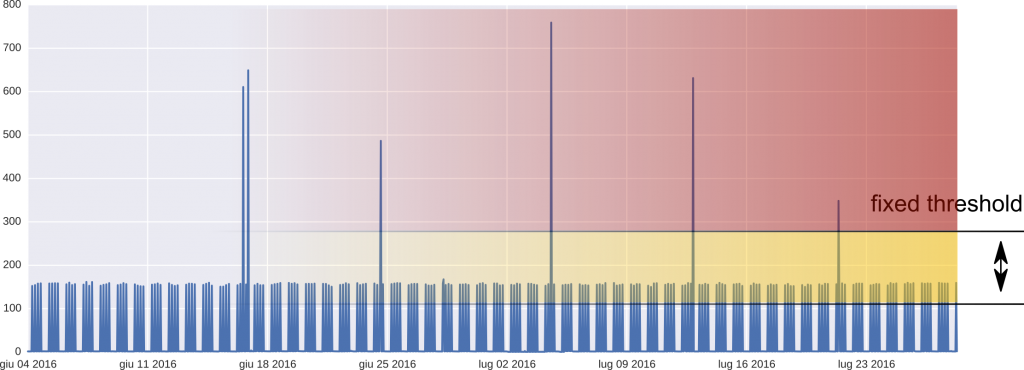

Normalerweise werden Alarme basierend auf Erfahrung und historischer Aktivität der zu messenden Größe generiert, basiert auf Zeiträumen, in denen kein Alarm ausgelöst hätte werden sollen (Standardaktivität, siehe Bild 1).

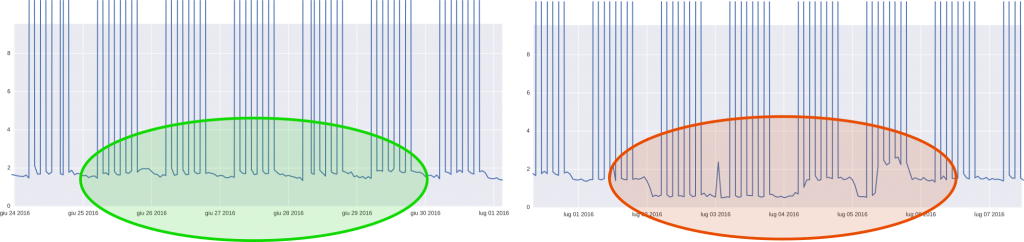

Alles unterhalb eines Grenzwertes wird dann als akzeptable Standardaktivität angesehen und sobald einer oder mehrere Werte über dem Threshold liegen, wird ein Alarm ausgelöst. Diese Art Grenzwert-basierter Alarmgenerierung ist robust gegenüber vielen Outliern und mag in Settings, wo sich der Mittelwert der Standardaktivität nicht dynamisch ändert, ausreichen (ansonsten muss auch der Grenzwert dynamisch angepasst werden). Signale können nun aber auch Anomalien enthalten, die sich ganz anders als traditionelle (mehr oder weniger extreme) Outlier äußern und trotzdem für eine zeitnahe Problemanalyse nützlich sind. Z.B. eine Veränderung der unterliegenden Wahrscheinlichkeitsverteilung oder Ähnliches (Bild 2, rot markierte Fläche) kann ein erstes Anzeichen für Instabilitäten sein und rechtzeitige Gegenmaßnahmen können helfen, ein wirkliches Problem gar nicht erst entstehen zu lassen.

Sich mit fortschrittlicheren Alarmmechanismen zu beschäftigen ist also durchaus sinnvoll. Hierbei sollten jene nicht als Ersatz für bereits gut funktionierende Strategien gedacht sein, sondern als Ergänzung. Man ist auf diese Weise einerseits in der Lage zwischen verschiedenen Arten von Anomalien zu unterscheiden, andererseits lassen sich auch Anomalien detektieren, die sonst nicht gefunden werden konnten. Dies bringt insbesondere das Monitoring via KPIs von immer komplexeren Netzwerken voran. Würth Phoenix S.r.l. beschäftigt sich momentan intensiv mit diesem Thema, um seinen Kunden wie bisher eine ausgezeichnete Alarmqualität beim Monitoring zu garantieren.

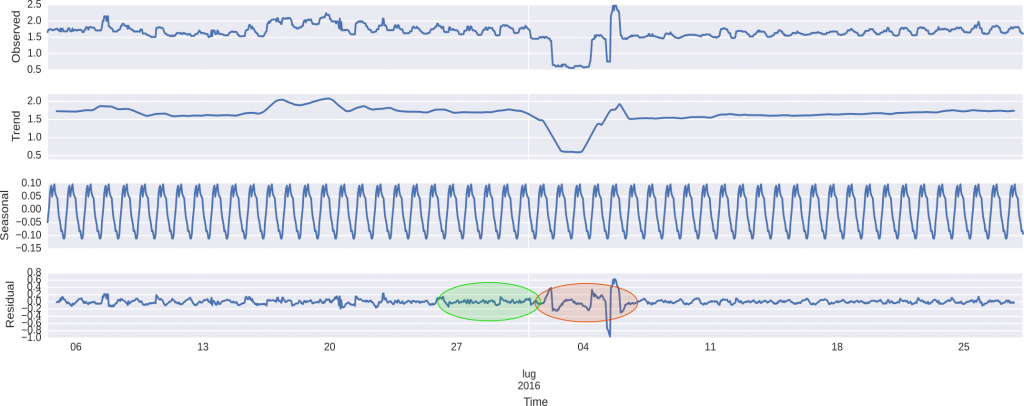

Zum Beispiel Methoden die das Gesamtsignal in mehrere Komponenten zerlegen (siehe oben) scheinen sich besonders zu bewähren. Bei dieser Vorgehensweise wird das Signal in einen Trend, in eine periodische Komponente und das Restsignal zerlegt. Das Restsignal ist für die genauere Analyse besonders relevant.

Wie kann so eine kompliziertere Analyse helfen noch bessere Alarme zu erzeugen?

Der Nutzen liegt auf der Hand. Einerseits wenn ein Monitoringsystem bei einem neuen Kunden eingerichtet wird: Während traditionelle Methoden auf eine gewisse Vorlaufzeit und historische Daten für korrektes Baselining angewiesen sind, kann ein automatisiertes Verfahren beinahe sofort eingesetzt werden (auch wenn sich die Qualität selbstverständlich auch hier mit historischen Daten zunehmend verbessert).

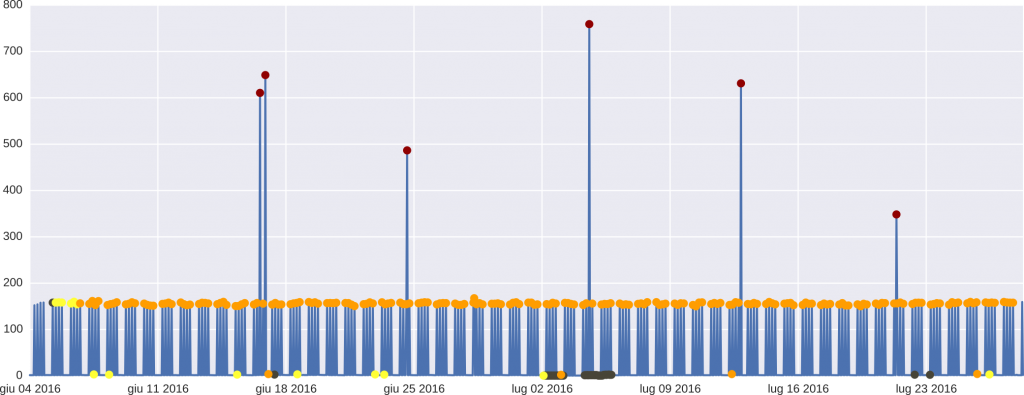

Sehr interessant ist insbesondere die Kombination traditioneller und neuer Methoden. Wenn Anomaly Detection z.B. hilft aus einer Flut von potentiellen, traditionell ermittelten Alarmen, die vermutlich relevantesten herauszusortieren und somit falsche Alarme zu vermeiden, ist das ein großer Schritt in eine zukunftsträchtige Richtung.